Обучение генеративной модели под стиль укиё-э

Концепция

Данный проект посвящён обучению Stable Diffusion и его применению для создания новых изображений. В качестве основы я решила использовать такое направление в искусстве как укиё-э и взять работы одного из художников этого направления — Утагава Куниёси.

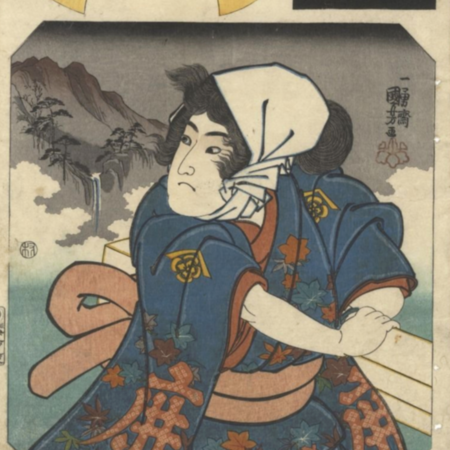

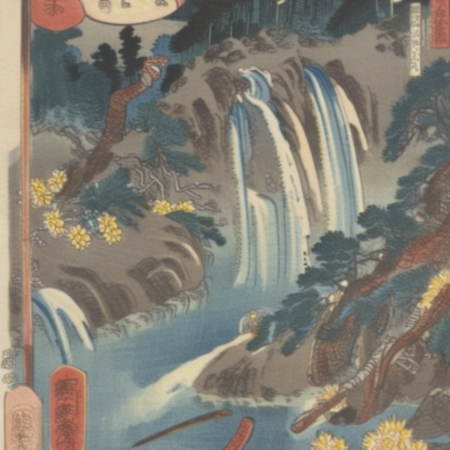

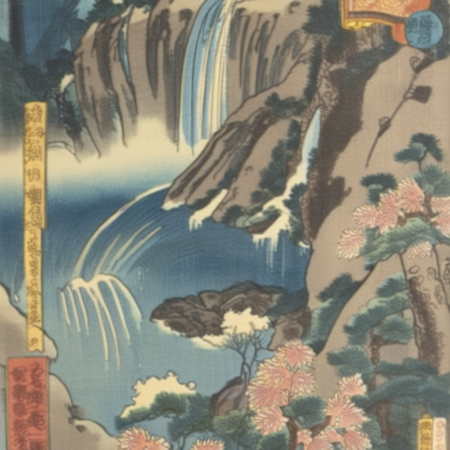

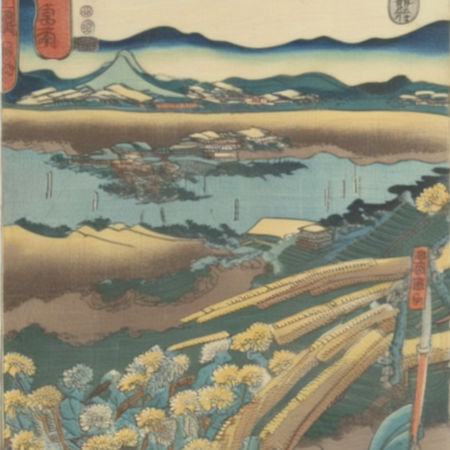

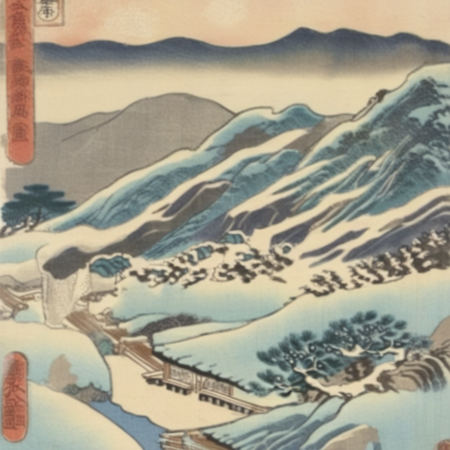

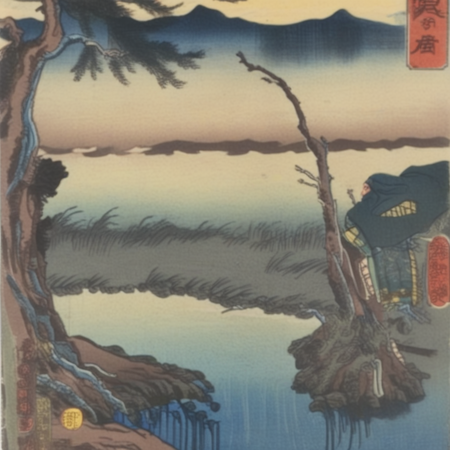

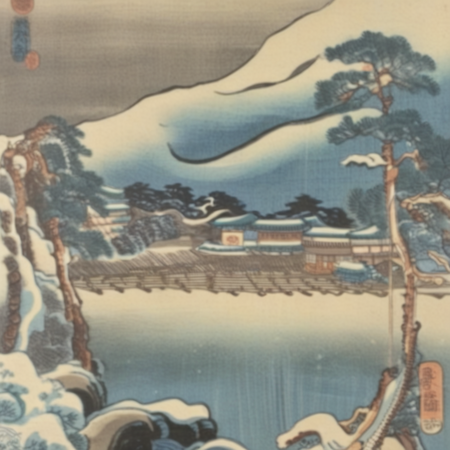

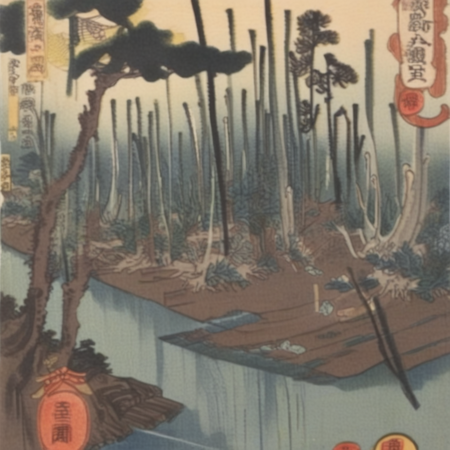

Картины Утагава Куниёси

Для обучения использовался датасет из 35 картин. Ниже представлены некоторые из них.

Сгенерированные изображения

Сперва я решила сгенерировать то, что часто встречается среди работ в стиле укиё-э — пейзажи.

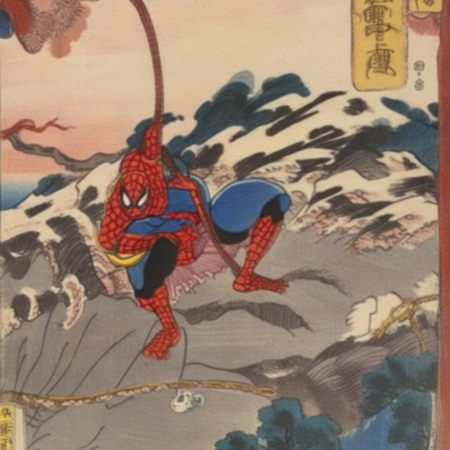

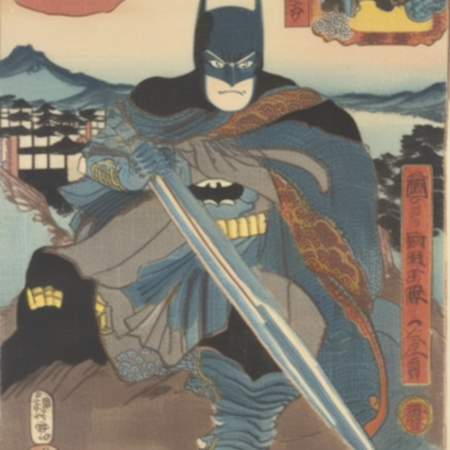

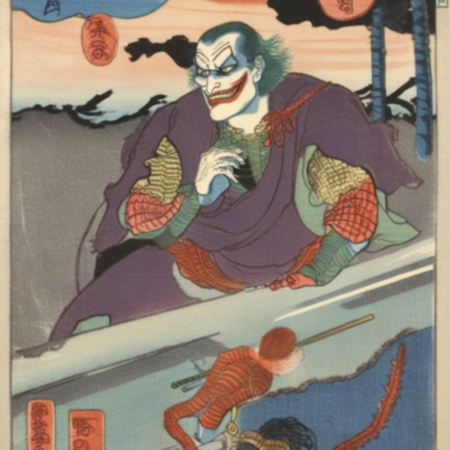

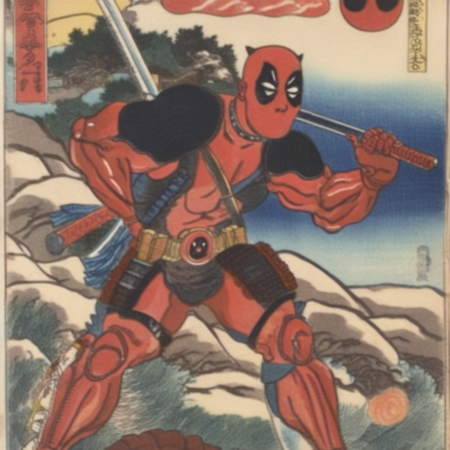

Сгенерированные изображения (комиксная версия)

После пейзажей я задумалась о том, насколько удачно модель могла бы осуществить различные необычные запросы и решила попробовать сгенерировать персонажей из комиксов.

Анализ изображений

Можно заметить, что в своих картинах Утагава в основном ставит людей на первый план, но, несмотря на это, при генерации пейзажей артефакты (случайные люди) возникали нечасто.

Все сгенерированные изображения не выбиваются из цветовой палитры, используемой в укиё-э. Так же сохраняется плоскость цветов и форм.

Тот самый артефакт

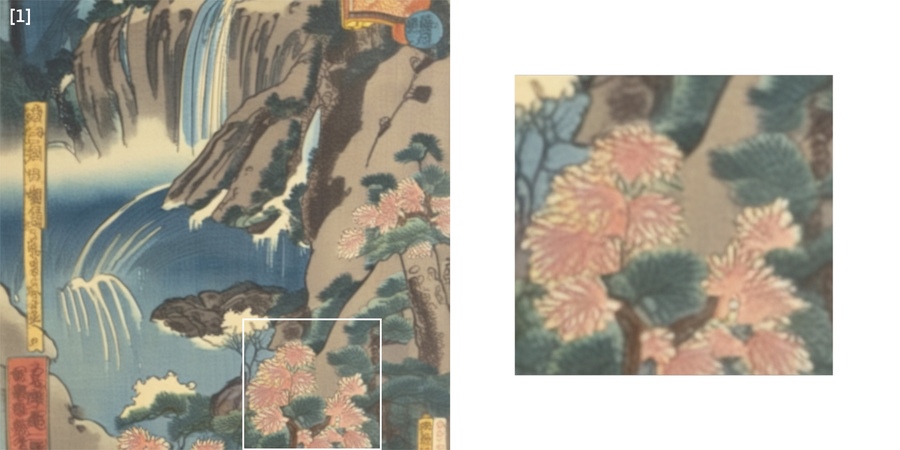

Не совсем удачно нейросеть справилась с рисованием цветов. На первый взгляд может показаться, что цветы получились хорошо, однако при приближении видно, что их форма повторяет форму листвы деревьев.

При этом в поданных на анализ работах есть «правильное» их изображение.

Сгенерированное изображение [1], картина Утагава Куниёси [2]

Существенно различаются лица сгенерированных персонажей от нарисованных художником.

Сгенерированное изображение [слева], картина Утагава Куниёси [справа]

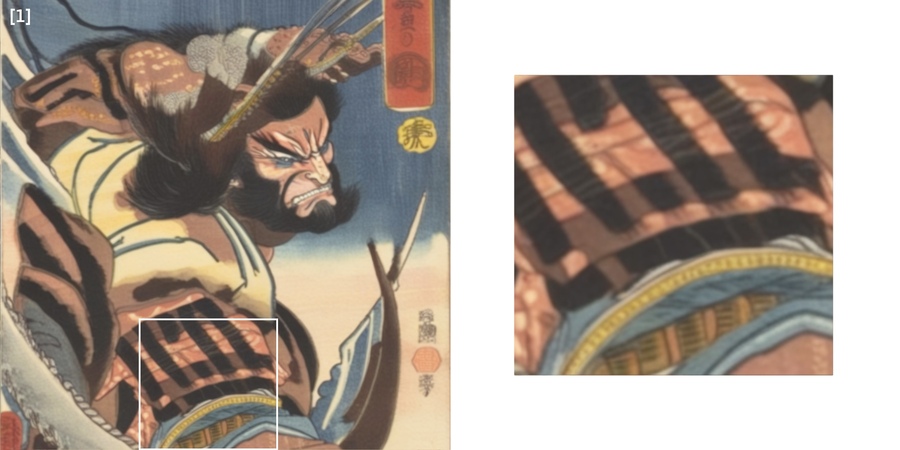

Одежда в картинах японского художника всегда яркая и переполнена разнообразными узорами. В изображениях героев комикса можно заметить попытки нейросети сымитировать эти самые узоры.

Сгенерированное изображение [1], картина Утагава Куниёси [2]

Из-за специфики костюмов совсем аккуратно изобразить нейросеть их не смогла, однако персонажи всё равно хорошо читаются и узнаются.

Примечательно, что почти у всех персонажей присутствует катана, которая постоянно изображается у героев картин Утагава.

Сгенерированное изображение [слева], картина Утагава Куниёси [справа]

В целом, все сгенерированные работы соответствовали стилю, которому была обучена нейросетевая модель. Из-за отсутствия вспомогательных средств для улучшения конечного результата, а также из-за определённой сложности стиля Утагава Куниёси в изображениях всё же было достаточно недочётов (например, отсутствие или появление некоторых объектов, слияние персонажа с фоном и т. д.), но это было ожидаемо.

Процесс обучения генеративной модели

Перед началом работы обновляются все библиотеки, загружаются diffusers и обучающий скрипт с GITHUB.

Далее загружается датасет с изображениями для дальнейшего обучения и проверяется правильность его отображения.

Следующий шаг — загрузка BLIP для создания подписей к изображениям.

Также добавляется идентификатор токена концепции к каждой подписи.

Теперь нужно подготовить модель к обучению.

Сперва инициализируется accelerate, а затем вводится токен, созданный заранее на Hugging Face для записи обучающей модели.

После подготовки можно начать само обучение.

Для запуска процесса устанавливается библиотека datasets и запускается команда, в которой указаны нужные параметры для генерации изображений.

Далее модель сохраняется на Hugging Face.

Финальный этап — непосредственно генерирование желаемых изображений. Для этого загружаются нужные модель и веса.

После остаётся только ввести промпт (запрос) и получить созданную картинку.

Ссылки на код и модель